A IA Generativa já virou vantagem competitiva. Mas, dentro de empresas, ela só escala de verdade quando nasce com controles de segurança e privacidade desde o início. Caso contrário, o risco aparece rápido: vazamento de dados sensíveis, respostas inadequadas, ataques de prompt, uso fora de políticas internas e, no limite, perda de confiança da liderança e do time de Segurança.

Hoje, a Auramind.ai lança um novo conjunto de Guardrails de Segurança construído sobre Amazon Bedrock e reforçado por muita inteligência humana dos nossos engenheiros, que desenvolveram um algoritmo para orquestrar políticas e reduzir risco em tempo real, tanto na entrada quanto na saída das conversas.

A seguir, o que entra em produção e por que isso importa para qualquer estratégia de IA Generativa corporativa.

Por que “guardrails” viraram requisito, não diferencial

Empresas querem acelerar produtividade com assistentes internos, copilotos e agentes. Mas precisam garantir quatro coisas:

- Segurança: bloquear abuso, engenharia social e prompt injection

- Privacidade: impedir que dados confidenciais circulem na conversa

- Conformidade: respeitar políticas internas e exigências regulatórias

- Governança: ter controles claros para aprovar, monitorar e evoluir o uso

Sem isso, a IA até funciona em piloto, mas trava quando chega no jurídico, no CISO e na diretoria.

O que foi lançado em Auramind.ai

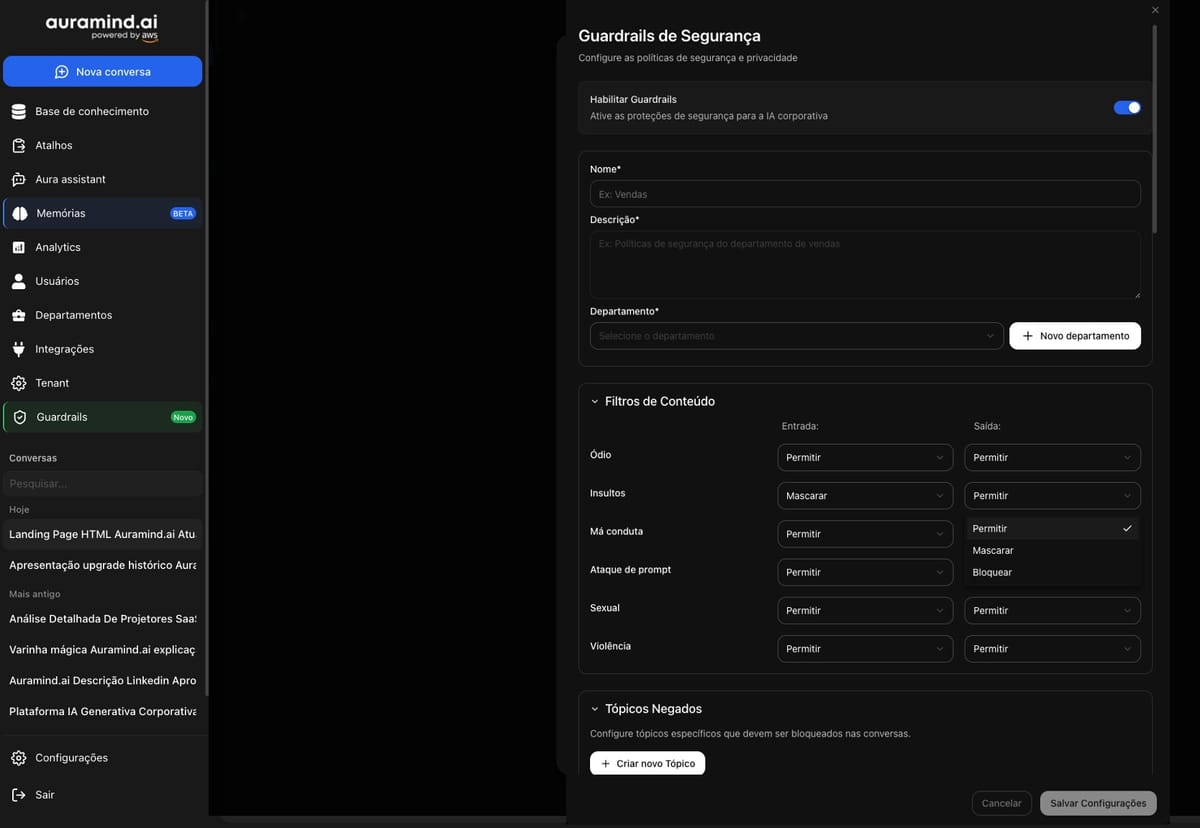

1) Habilitar Guardrails

Um switch claro para ativar as proteções e padronizar o comportamento da IA corporativa, com políticas configuráveis.

2) Filtros de Conteúdo

Proteções aplicadas em Entrada e Saída, com categorias como:

- Ódio

- Insultos

- Má conduta

- Ataque de prompt

- Sexual

- Violência

Na prática: reduzimos a chance de o usuário “forçar” a IA a sair do trilho (prompt attack) e evitamos que a IA gere conteúdo inadequado, mesmo quando provocada.

3) Tópicos Negados

Aqui mora o que as empresas mais pedem: bloquear assuntos específicos que não devem aparecer em conversas.

Exemplos comuns no mundo corporativo:

- discussões sensíveis (M&A, desligamentos, investigações internas)

- recomendações fora de política (jurídico, saúde, crédito, etc.)

- informações de estratégia e operação que precisam de fluxo formal

Você define os tópicos, e a Auramind.ai bloqueia quando o assunto surgir.

4) Filtros de Palavras

Além de tópicos, algumas empresas precisam de algo mais direto: filtrar palavras e frases específicas.

Útil para:

- nomes de projetos internos (codenames)

- termos que indicam tentativa de extração de informação

- vocabulário que viola políticas internas (ex.: senhas, credenciais, “cole aqui o token”, etc.)

5) Informações Confidenciais

Esse é o coração da privacidade em IA corporativa: detectar e bloquear (ou tratar) dados que não devem trafegar na conversa.

Cobertura lançada inclui, entre outros:

- E-mail, Telefone, Endereço, Nome

- SSN, identificadores fiscais e documentos (EUA, Canadá, Reino Unido)

- CPF Brasil

- Cartão de Crédito/Débito, CVV, Data de Expiração

- Conta bancária, roteamento, IBAN, SWIFT

- Endereço IP, Endereço MAC, URL

- Nome de usuário, Senha, PIN

- ID do Motorista, Placa, VIN

- Chave de Acesso AWS, Chave Secreta AWS

- Idade

Isso reduz drasticamente o risco de alguém enviar dados sensíveis para IA ou tentar extrair segredos via engenharia social.

6) Mensagem de Bloqueio Padrão

Quando algo é bloqueado, a experiência precisa ser consistente e educativa. Por isso há uma mensagem padrão de bloqueio, que você pode usar para orientar o colaborador sobre o que fazer em seguida (por exemplo, buscar um canal oficial, abrir um chamado, ou usar uma base aprovada).

O que muda para a empresa

- Menos risco de vazamento e incidentes

- Mais confiança para liberar o uso para mais equipes

- Menos atrito com auditoria, governança e compliance

- Mais previsibilidade do que entra e sai da IA

- Um caminho mais rápido do piloto para produção

Se a IA é a nova interface de trabalho, guardrails são o novo controle de acesso.

Agende uma reunião agora e descubra como utilizar este e outros recursos da Auramind.ai na sua empresa para escalar a IA Generativa com segurança, privacidade e governança desde o primeiro dia.